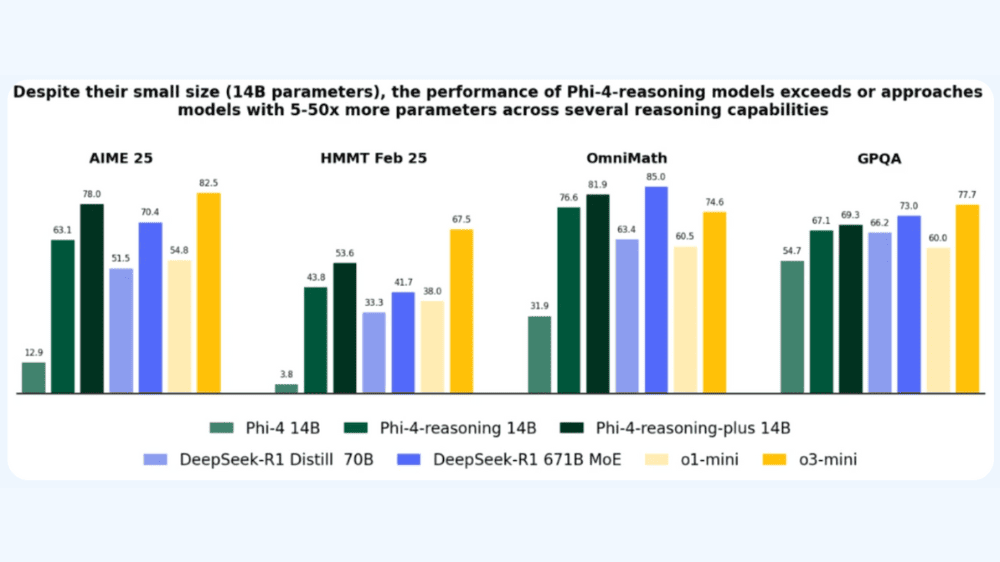

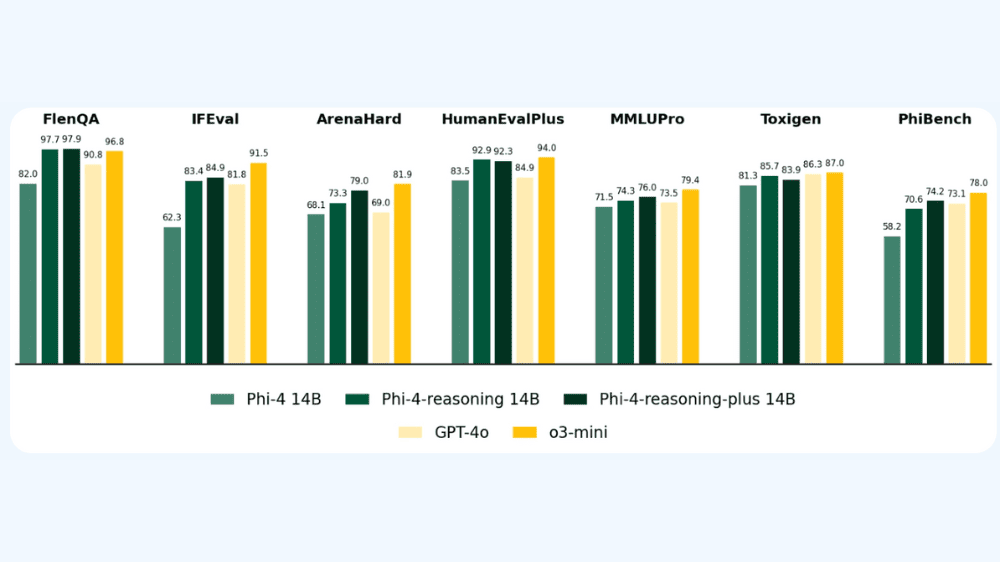

小型言語モデル(SLM)が、AI推論の世界において大きな存在感を示し始めました。Microsoftが発表したPhi-4シリーズは、わずかなパラメータ数にも関わらず、数学的推論などの高度なタスクで巨大モデルを凌駕する成果を挙げています。中でも、Phi-4-reasoningは140億パラメータながら、大規模モデルに迫る推論性能を示し、特に数学や科学領域のベンチマークで優れた成績を残しています。Phi-4-reasoning-plusはその拡張版で、推論時間とトークン数を増やすことで精度を向上させています。そして、Phi-4-mini-reasoningは38億パラメータで軽量ながらも高い数学的推論力を持ち、教育用途やエッジデバイス向けに最適化されています。

Phi-4-Reasoningシリーズの概要

Phi-4は、Azure AI Foundryから登場した小型ながら高性能な推論モデル群です。今回新たに発表されたのは以下の3つです。

- Phi-4-reasoning:140億パラメータのオープンウェイトモデル。

- Phi-4-reasoning-plus:さらにトークン長と精度を強化した強化学習版。

- Phi-4-mini-reasoning:38億パラメータで、エッジや教育用途に特化。

これらはいずれも、高品質なデータと高効率なトレーニング戦略を用いることで、小型でありながら大型モデルと並ぶ性能を実現しています。

Phi-4-reasoningは、OpenAIのo3-miniやDeepSeek-R1-Distill-Llama-70Bと比較しても、数学や科学分野のタスクで優れた結果を出しています。特に、米国数学オリンピック予選(AIME 2025)において、DeepSeekの大規模モデル(671B)を上回る性能を記録。Phi-4-reasoning-plusは、推論時間を長く取り、多くのトークンを処理することで、さらに精度を向上。少ないリソースで大きな成果を得られるというSLMの魅力を最大限に引き出しています。

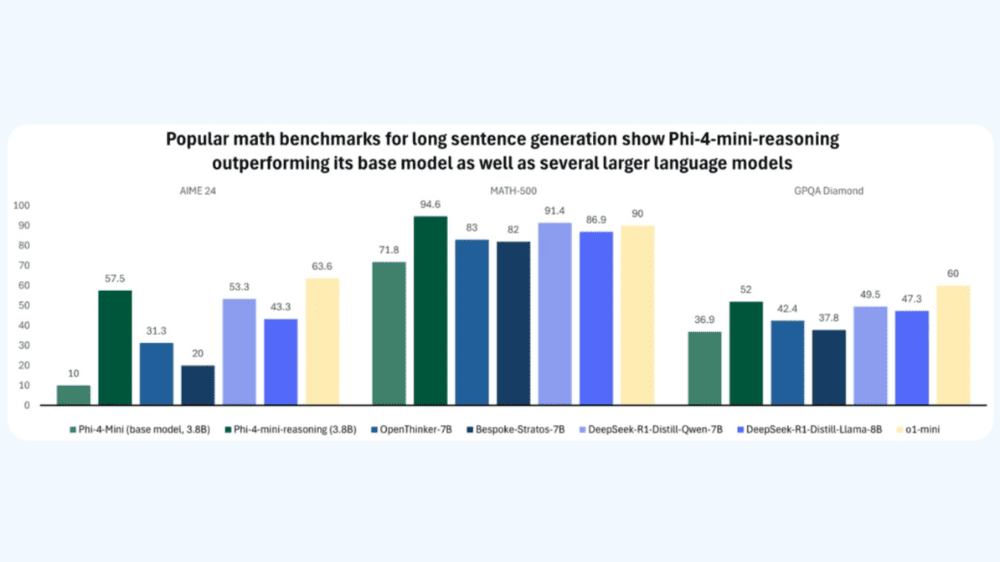

Phi-4-mini-reasoningは、エッジデバイスや教育現場を想定した軽量モデルで、少ない計算資源でも複雑な数学問題のステップバイステップ解決が可能です。トレーニングには100万問以上の多様な数学問題が使われており、中学生から博士レベルまでの幅広い応用が期待されています。さらに、同サイズ帯のOpenThinker-7BやLlama-3.2-3B-instructなどを上回るパフォーマンスを示し、小型モデル市場における競争力の高さが際立っています。

PhiモデルはWindows 11デバイスへのローカル実装を視野に最適化が進んでおり、CPUやGPU、さらにはCopilot+ PCに搭載されるNPU(Neural Processing Unitの略で、AI(人工知能)の処理に特化したプロセッサのこと)でも動作可能です。OutlookなどのMicrosoft製品においても、オフラインでのAI機能利用が可能となり、ユーザー体験が大きく変わる可能性があります。

「Phi-4-Reasoningシリーズ」について一言

Phi-4 reasoningとreasoning-plusの登場は、小型モデルが大型モデルに匹敵する推論性能を持つ時代の到来を明確に示しました。これらのモデルは、AIMEなどの難関ベンチマークで大型モデルを上回るスコアを記録しており、パラメータ数だけでは測れない「推論設計力」の重要性を浮き彫りにしています。その背景には、OpenAI o3-mini由来の高品質な学習デモンストレーションや、精緻な強化学習設計、そして合成データ活用の巧みさがあると考えられます。

さらに、これらのモデルがCopilot+ PCで動作可能な軽量性を維持していることは、通信環境が不安定な現場(例:製造業の現場端末、屋外の建設・保守作業、災害時の情報端末など)での需要を示唆しています。クラウドアクセスなしで高精度な推論が行えることは、リアルタイム性や機密性が重視される分野において大きな利点となるでしょう。

出所:One year of Phi: Small language models making big leaps in AI