ニューラルネットワークとは、人間の脳の仕組みを再現した学習モデルであり、機械学習や人工知能の分野で広く活用されています。脳内の神経細胞であるニューロンが相互に接続しながら情報を処理するように、ニューラルネットワークも多層構造を持ち、データのパターンを学習します。近年では、ディープラーニングの進化により、画像認識や自然言語処理、自動運転などの分野で実用化が進んでいます。

ニューラルネットワークは単なる分類や回帰のタスクだけでなく、音声認識や画像生成などのクリエイティブな分野にも応用されています。現代社会において、ニューラルネットワークはAI技術の中心的な存在となり、その進化が産業や日常生活に大きな影響を与えています。

ニューラルネットワークとは

ニューラルネットワークとは、人間の脳の神経回路を数学的に表現した学習モデルです。脳内の神経細胞であるニューロンの構造を模倣し、データのルールやパターンを自動的に学習する仕組みとして機械学習の分野で活用されています。人間の脳には何十億ものニューロンが張り巡らされており、ニューロン同士が相互に結びついて神経回路を形成しています。人間が情報を感知するとニューロンに電気信号が伝わり、伝達経路によってパターンを認識します。ニューラルネットワークはこの仕組みを再現するために設計されました。

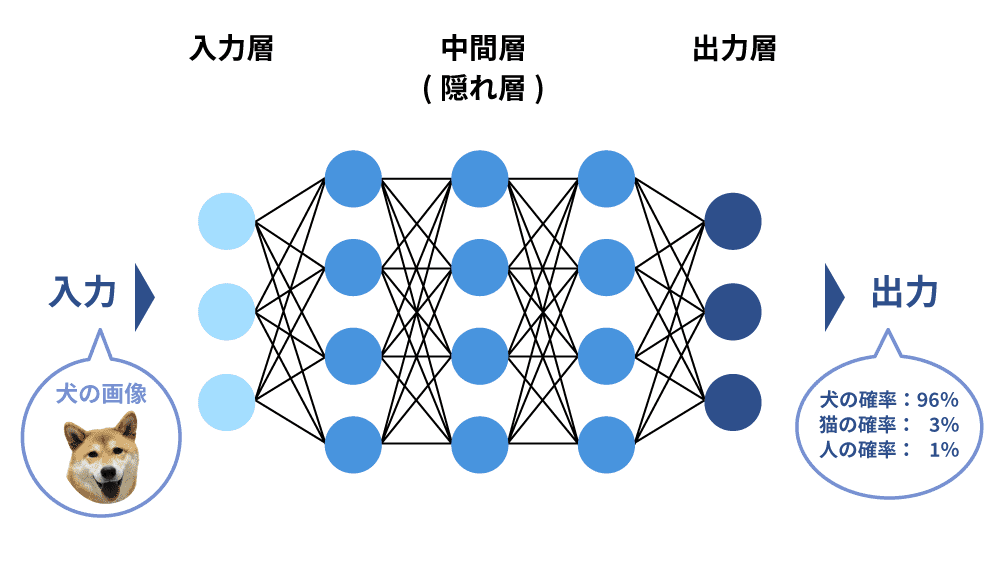

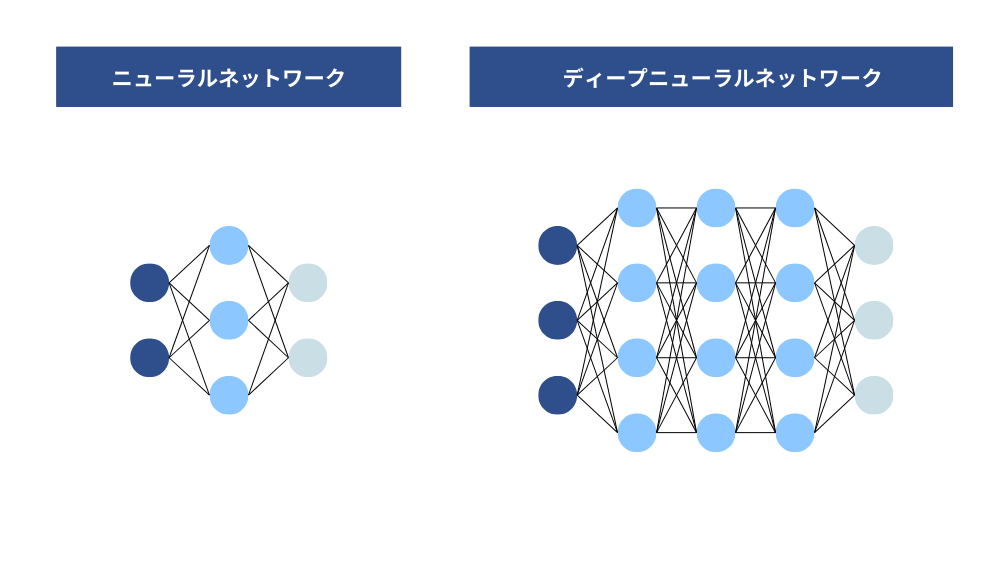

ニューラルネットワークは入力層、隠れ層、出力層で構成されており、各層のニューロン同士は重みと呼ばれる値を介して接続されています。この重みにより学習データに基づいて特徴を抽出し、パターン認識や予測を行うことができます。また、ニューラルネットワークを多層にしたものがディープラーニングです。ディープラーニングは、複数の隠れ層を持つことでより複雑なパターンを学習できるため、音声認識や画像認識、自動運転、新薬開発などさまざまな分野で活用されています。

ニューラルネットワークは、データを学習し、その中にある規則性を見つけ出すことに長けているため、音声や画像認識、時系列予測、モデリングといった分野で広く利用されています。現在のAI技術の基盤を支える重要な要素であり、機械学習や深層学習を理解する上で欠かせない概念といえます。

ニューラルネットワークの重要性

ニューラルネットワークは人間の神経細胞の仕組みを模した学習モデルであり、入力層、隠れ層、出力層の3層で構成されています。データに対して重み付けを行うことで特徴を学習し、高度な意思決定を可能にする技術です。

従来のアルゴリズムでは解決が難しかった課題や多くの計算リソースを必要とした問題に対しても、ニューラルネットワークの活用によって解決が進んでいます。特に、2010年頃までは教師あり学習が中心でしたがディープラーニングの登場により、高度な問題解決が次々と実現し、AI分野における大きな転換点となりました。現在ではニューラルネットワークとディープラーニングはAI開発に欠かせない技術となっています。

自動運転や製薬など、さまざまな分野でニューラルネットワークが活用されており、仕組みを意識することは少ないものの、多くの場面で恩恵を受けています。特に、画像認識や音声認識の精度は向上しており、時には人間の判断を上回るケースもあります。

機械学習とディープラーニングの違い

機械学習とディープラーニング(深層学習)の最大の違いは、AIの学習過程における人間の関与の度合いです。

機械学習ではAIが学習する際に特徴量を事前に設定する必要があります。どの特徴量を使うかは人間が判断し、問題が複雑になるとデータサイエンティストやエンジニアが関与することになります。一方、ディープラーニングではAIがデータから自発的に特徴量を抽出します。そのため、大量のデータが必要になり、学習には多くの時間とコストがかかりますが、人間では処理しきれない膨大なデータから有用な特徴を見つけ出せる点が大きなメリットです。

機械学習はニューラルネットワークを活用する学習モデルの1つであり、教師あり学習や教師なし学習もその中に含まれます。ディープラーニングはニューラルネットワークの層を深くしたディープニューラルネットワーク(DNN)を用いた手法です。層が多いため学習コストは上がりますが、従来の方法では対応できなかった複雑な問題にも対応できる可能性があります。

また、ディープラーニングは入力データから直接特徴を抽出して学習するため、自動翻訳や音声認識などの高度な識別を必要とする分野に適しています。さらに、ADAS(先進運転支援システム)や交通標識認識といった自動運転技術にも応用されています。

ニューラルネットワークの仕組み

ニューラルネットワークは入力層、隠れ層、出力層の3つの層で構成されています。入力層がデータを受け取り、隠れ層でデータの処理や特徴抽出を行い、出力層が最終的な結果を算出します。

最初に開発されたパーセプトロン(機械が物事を判断するための単純なルール、初期のニューラルネットワーク)は入力層と出力層のみで構成されていましたが、線形分離不可能な問題(2つのカテゴリに分けることができない問題)に対応できないという制約がありました。その後、隠れ層を追加することで、ネットワーク全体の表現力が向上し、非線形な分類や複雑な問題にも対応できるようになりました。隠れ層を複数持つモデルは多層パーセプトロンと呼ばれ、現在のディープラーニングの基礎となっています。

ニューラルネットワークの動作は、大きく入力、伝播、出力の3つの工程に分けられます。

- 入力:画像、音声、テキストなどのデータを入力層に与えます。

- 伝播:各ノードの出力値に対応する重みを掛け、合計値を計算し、その後、活性化関数を適用し、次の層へ伝達します。この過程を出力層に到達するまで繰り返します。

- 出力:最終的な結果を出力し、必要に応じて学習に活用します。

ニューラルネットワークは、単純な人工ニューロンを多数組み合わせることで、複雑な関数近似が可能になり、従来の機械学習では対応できなかった分類や回帰の問題にも適用できるようになりました。

入力層・隠れ層・出力層の構成

- 入力層:データを受け取る層

- 隠れ層:データの処理・分析を行う層

- 出力層:最終的な結果を算出する層

特に隠れ層の働きが重要であり、複数の隠れ層を持つことで、複雑なデータの特徴を学習できるようになります。

重みの設定

ニューラルネットワークでは、ノード同士の結合部分(シナプス)に重みが設定されており、この重みがデータの伝達の強さを決定します。学習過程では、この重みを調整しながら最適化を行います。脳の神経細胞(ニューロン)のシナプス結合の強さが変化するように、ニューラルネットワークも勾配法などを用いて重みを最適化し、精度を向上させます。

反復学習

ニューラルネットワークの学習は入力と出力を繰り返しながら重みを調整することで進みます。出力層で正解に近い結果を得られるように微調整を繰り返し、最終的には高精度な予測や識別を実現します。この仕組みにより、ディープラーニングを活用した画像認識や音声認識、自動運転、医療診断など、さまざまな分野でニューラルネットワークが活躍しています。

ニューラルネットワークの主な学習手法

ニューラルネットワークの学習にはさまざまな手法がありますが、代表的なものとして以下の3つが挙げられます。

- Dropout法:過学習を防ぐために学習時にランダムにニューロンを無効化する手法。特定のニューロンに依存しない学習を促進し、モデルの汎化性能を向上させます。

- 確率的勾配降下法(SGD):ランダムに選んだデータの一部を用いてパラメータを更新する方法。計算コストを抑え、大規模データでも効率的に学習できます。

- 誤差逆伝播法(Back Propagation):出力層で生じた誤差を逆方向に伝播させ、ネットワーク全体の重みを調整する手法。ニューラルネットワークの基本的な学習アルゴリズムとして広く使われています。

上記の手法を適切に組み合わせることで、より高精度なニューラルネットワークの学習が可能になります。

Dropout法

Dropout法はニューラルネットワークの過学習を防ぐために提案された手法です。学習時に一定の確率でランダムにニューロンを無効化し、モデルの汎化性能を向上させます。

過学習とは、訓練データに対する正答率が向上する一方で、テストデータの誤差が減少しなくなり、逆に増加し始める現象を指します。ニューラルネットワークの構造が複雑になると、ニューロンの重みが訓練データに最適化され、未知のデータに対応できなくなることがあります。

過学習を防ぐ方法には、以下のようなものがあります。

- 訓練データの増加

- モデルの複雑性を抑える

- Early Stopping(早期終了)

- モデルの複雑さにペナルティを与える(正則化)

Dropout法は正則化の一種であり、学習時にランダムにノードを無効化し、特定のニューロンに依存しない学習を促進することで汎化性能が向上し、過学習を抑制できます。

>過学習とは?発生要因と対策方法

確率的勾配降下法(SGD)

確率的勾配降下法(Stochastic Gradient Descent、SGD)は、最急降下法の一種であり、パラメータの更新にランダムに選ばれたデータの一部を使用する手法です。

一般的な最急降下法では、すべてのデータを用いて勾配を計算するため、計算コストが高く、局所解に陥るリスクがありますが、SGDではランダムに選んだデータの一部を使って逐次的に更新を行うため、局所解から抜け出しやすく、大規模なデータセットでも効率的に学習を進めることができます。

SGDのメリットは次の通りです。

- 計算コストが低く、大規模なデータセットにも適用可能

- ランダムにデータを選ぶため、局所解に陥りにくい

- 継続的な学習が可能で、オンライン学習にも適している

誤差逆伝播法(Back Propagation)

誤差逆伝播法(Back Propagation)は、多層パーセプトロンの学習に用いられるアルゴリズムです。ニューラルネットワークの各層の重みを調整し、出力を正解に近づけることを目的としています。

誤差逆伝播法では次のように出力層で発生した誤差を逆方向に伝播させ、各層の重みを調整します。

- 入力データを用いて順方向に計算し、出力値を求める。

- 出力値と正解データの誤差を計算する。

- 誤差を出力層から入力層へと逆方向に伝播させ、各層の重みを調整する。

- 調整後の重みを用いて再学習を行い、精度を向上させる。

この方法によって、ニューラルネットワークは徐々に適切な重みを見つけ出し、パターン識別や関数近似をより効率的に行えるようになります。誤差逆伝播法は、ニューラルネットワークの基盤となる学習手法であり、現在のディープラーニングの発展において不可欠な技術です。

ニューラルネットワークの種類

ニューラルネットワークにはさまざまな種類があり、それぞれ異なる特徴や用途を持っています。代表的なものとして、以下の6つが挙げられます。

- ディープニューラルネットワーク(DNN):隠れ層を複数持つ多層ニューラルネットワーク。高い表現力を持ち、画像認識や自然言語処理など幅広い分野で利用されます。

- 畳み込みニューラルネットワーク(CNN):画像認識に特化したモデル。畳み込み層とプーリング層を活用し、特徴を自動抽出します。

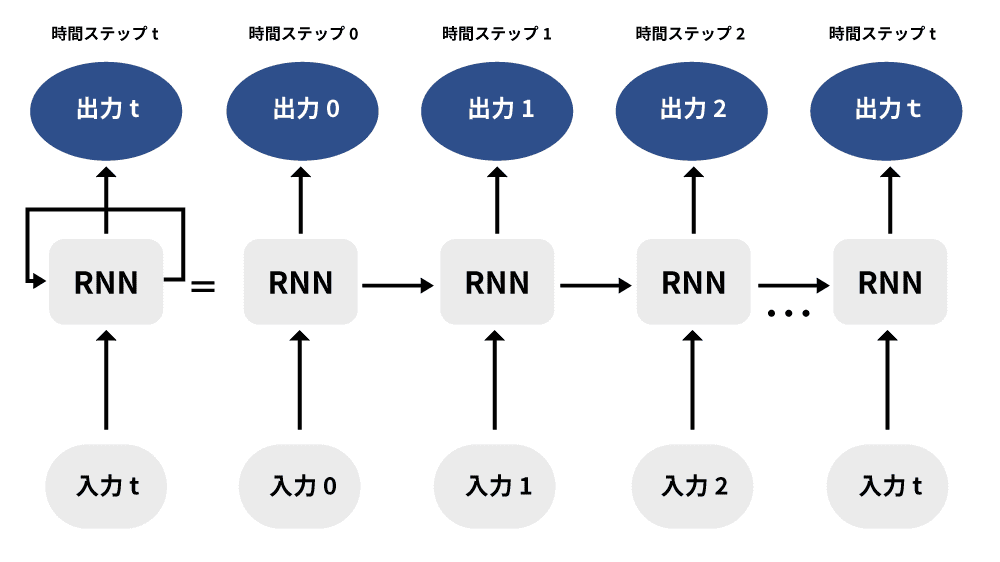

- 再帰型ニューラルネットワーク(RNN):時系列データを扱うモデル。音声認識や機械翻訳などに適用されます。

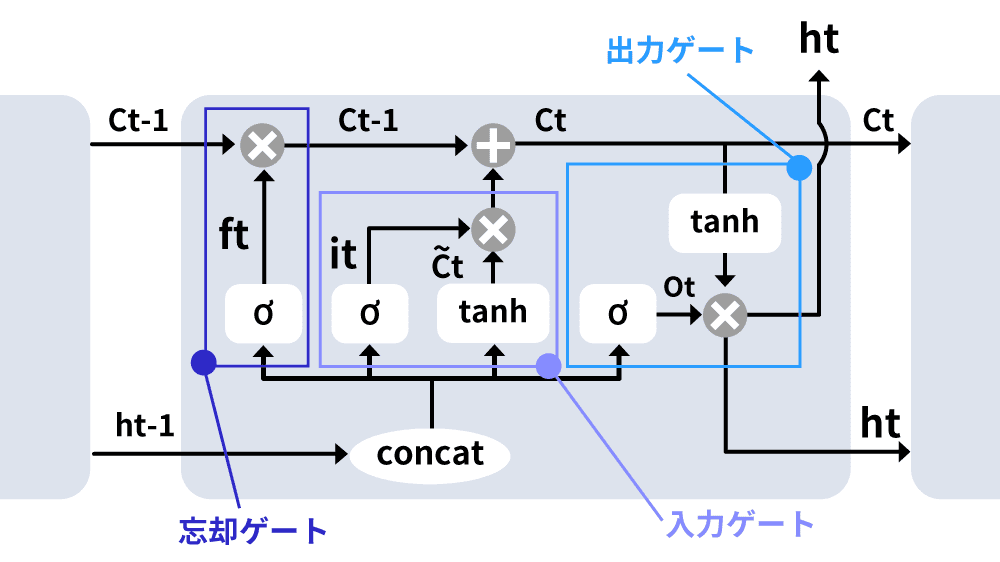

- LSTM:RNNの改良版。長期的な依存関係を考慮した学習が可能で、文章生成や音声解析などに用いられます。

- GRU:LSTMの簡易版。計算効率が高く、機械翻訳や音声認識などの時系列データ処理に適用されます。

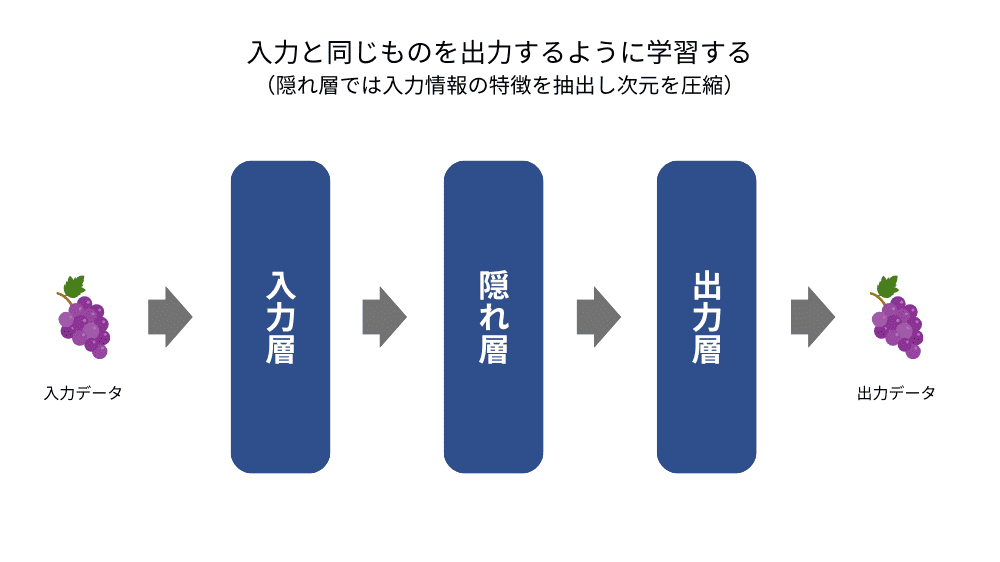

- 自己符号化器(オートエンコーダ):データの圧縮や異常検知に用いられるモデル。入力と出力を一致させるように学習します。

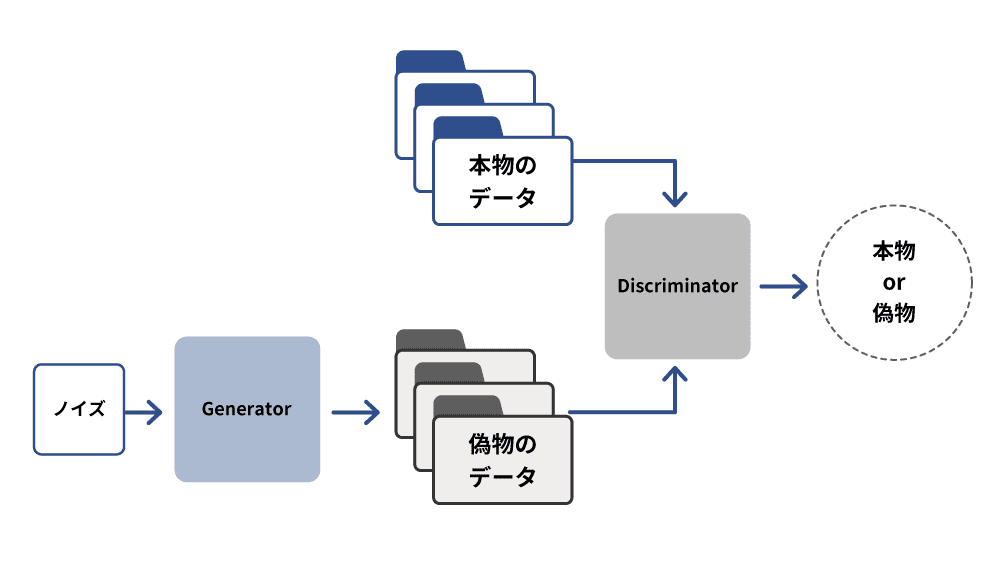

- 敵対的生成ネットワーク(GAN):画像や音声の生成に使われるモデル。データを識別するディスクリミネータと、新しいデータを生成するジェネレータが競争しながら学習します。

それぞれのニューラルネットワークは、特定の用途に応じて最適化されており、AI技術の発展を支える重要なモデルとなっています。

ディープニューラルネットワーク(DNN)

ディープニューラルネットワーク(Deep Neural Network、DNN)は、ニューラルネットワークを多層に重ねた深層学習モデルです。従来のニューラルネットワークは入力層・隠れ層・出力層の3層構造であり、単純な問題しか解決できませんでした。しかし、隠れ層を増やすことでより複雑なパターンを学習できるようになりました。

DNNは少なくとも4層以上のニューラルネットワークで構成されており、ディープラーニングの中心的な技術として広く利用されています。初期のニューラルネットワークでは、層を増やすと学習が難しくなるという課題がありましたが、2006年以降のディープラーニング技術の発展により、この問題が解決されました。さらに、2010年頃からのビッグデータの普及やGPUの計算能力の向上によって大規模なDNNの学習が可能になったことにより、DNNは画像認識、自然言語処理、音声認識、自動運転など、さまざまな分野で活用されるようになりました。

DNNの強みは、多層構造によって大量のデータを学習し、高度なパターン認識や推論が可能になる点です。従来のニューラルネットワークに比べて、汎用性が高く、複雑なタスクにも適用できるため、AI技術の発展を支える重要なモデルとなっています。

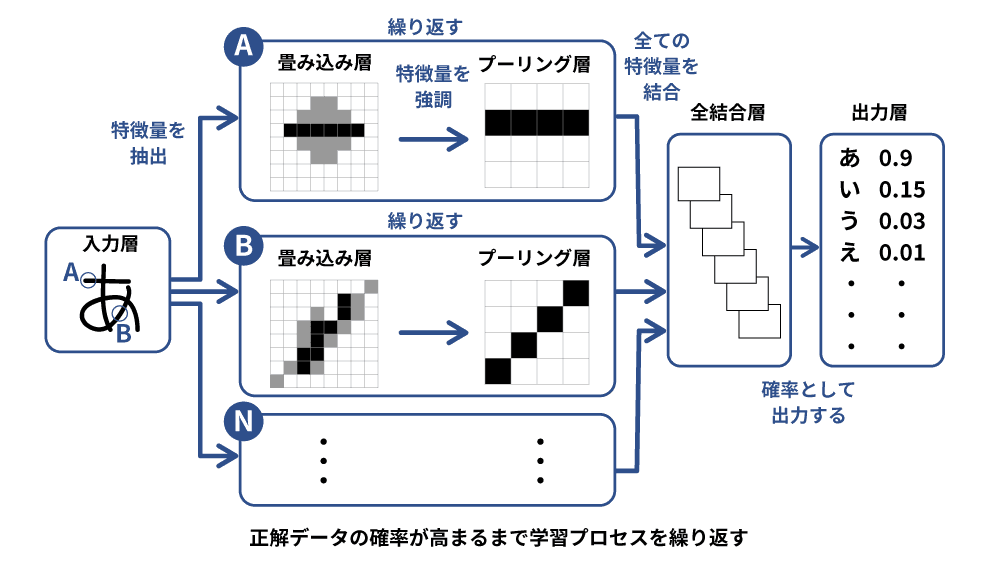

畳み込みニューラルネットワーク(CNN)

畳み込みニューラルネットワーク(Convolutional Neural Network、CNN)は、主に画像認識に特化したニューラルネットワークの一種です。畳み込み層とプーリング層といった特殊な層を持ち、画像の特徴を効率的に抽出し、高精度な認識を実現します。

CNNの特徴は画像データを直接入力し、畳み込み層を通じてエッジやテクスチャなどの特徴を抽出する点です。その後、プーリング層でデータの次元を圧縮し、重要な情報のみを保持しながら計算コストを削減します。このプロセスにより従来の機械学習手法よりも高い認識精度を実現できます。

主な用途としては画像認識、顔認識、医療画像診断、物体検出などが挙げられます。また、自然言語処理の分野でも活用され、テキスト分類や感情分析などのタスクに応用されています。Googleのニューラル機械翻訳やFacebookの画像自動タグ付けなど、さまざまな実用例があります。

再帰型ニューラルネットワーク(RNN)

再帰型ニューラルネットワーク(Recurrent Neural Network、RNN)は、時系列データや連続的なデータを処理するためのニューラルネットワークです。特に、自然言語処理や音声認識など、データの前後関係が重要なタスクに適用されます。

RNNの特徴は以前の計算結果を保持し、それを次の計算に活用できる点です。通常のニューラルネットワークは入力データを独立したものとして処理しますが、RNNは過去の情報を考慮しながら学習することで、文脈を理解しやすくなります。そのため、機械翻訳や音声認識、株価予測、動画解析などに利用されています。

ただし、従来のRNNには長期的な依存関係を処理しにくいという課題がありました。この問題を解決するために、LSTM(Long Short-Term Memory)やGRU(Gated Recurrent Unit)といった改良型のRNNが開発され、より高精度な学習が可能になっています。

LSTM(Long Short-Term Memory)

LSTM(Long Short-Term Memory、長・短期記憶)は、再帰型ニューラルネットワーク(RNN)の改良版であり、長期間にわたる依存関係を考慮した学習が可能なモデルです。RNNは時系列データを処理できる一方で、過去の情報を長期間保持するのが難しいという課題がありました。LSTMはこの問題を克服するために設計され、自然言語処理や時系列データの予測などのタスクに広く利用されています。

LSTMの特徴的な要素としてゲート機構が挙げられます。ゲートは情報の取捨選択を行い、不要な情報を忘却しながら重要な情報を保持する役割を果たします。主に以下の3つのゲートが存在します。

- 忘却ゲート(Forget Gate):不要な情報を削除し、必要な情報のみを保持

- 入力ゲート(Input Gate):新しい情報をどの程度記憶するかを制御

- 出力ゲート(Output Gate):次の状態へどの情報を伝えるかを決定

LSTMは長期的な文脈を維持しながら学習でき、文脈を考慮した文章生成や季節変動のあるデータの予測などに適用されます。例えば、機械翻訳、音声認識、株価予測、医療データ解析など、多くの分野で活用されています。LSTMの登場により、従来のRNNでは扱えなかった長期依存関係を持つデータの学習が可能になり、ディープラーニングの発展を大きく後押ししました。

GRU(Gated Recurrent Unit)

GRU(Gated Recurrent Unit)は、LSTMの簡易版として開発された再帰型ニューラルネットワークの一種です。LSTMの3つのゲート(入力ゲート、忘却ゲート、出力ゲート)のうち、出力ゲートを省略し、2つのゲート構成にすることで、計算効率とモデルの軽量化を実現しています。

GRUはLSTMよりもパラメータ数が少なく、計算効率が高いという特徴があります。出力ゲートを省略したシンプルな構造により、計算コストを削減しながら、短〜中程度の系列データに適用できる点が強みです。RNNの長期依存関係の課題をある程度解決しつつ、LSTMほどの負荷を必要としないため、機械翻訳や音声認識、動画解析などの分野で広く利用されています。

自己符号化器(オートエンコーダ)

自己符号化器(オートエンコーダ)は、ニューラルネットワークを活用した教師なし学習の手法の1つです。入力データを圧縮し、必要な特徴のみを抽出しながら復元する仕組みを持ち、次元削減や異常検知、ノイズ除去などに用いられています。

オートエンコーダの構造は入力層・隠れ層・出力層の3層で構成され、入力データと同じデータを出力するように学習します。隠れ層ではデータの特徴を抽出・圧縮するエンコーダと圧縮されたデータを元の形に復元するデコーダの2つのプロセスが機能します。このため、単なるデータのコピーではなく、重要な情報を保持したデータ表現を学習できるのが特徴です。

オートエンコーダは異常検知システムや画像ノイズ除去、データ圧縮などの用途で活用されています。また、深層学習の初期段階では、オートエンコーダを多層に重ねたスタックドオートエンコーダがディープラーニングの基礎技術として用いられていました。近年では、画像や音声データの生成にも応用され、データの特徴を学習して新しいデータを生成するモデルの基盤としても利用されています。

敵対的生成ネットワーク(GAN)

敵対的生成ネットワーク(Generative Adversarial Network、GAN)は生成モデルの一種で近年注目を集めるモデルです。データの真贋を見抜くディスクリミネータと、ディスクリミネータが見間違えるようなデータを生成するジェネレータによって構成されます。両者の繰り返しにより、本物と見分けがつかないほどのデータが作成されます。存在しないデータの生成や特徴にあわせた変換が可能であり、画像認識などに多く用いられます。

ニューラルネットワークの活用事例

機械翻訳・自然言語処理

ニューラルネットワークは、機械翻訳や自然言語処理の分野で広く活用されています。Googleは2016年にGoogleニューラル機械翻訳システム(GNMT)を導入し、それまでの統計的翻訳手法に代わる新たなアプローチを採用しました。従来の翻訳システムでは単語やフレーズごとに翻訳し、それを組み合わせて文章を作成するため、文脈の考慮が不十分で不自然な訳文が生じることがありましたが、ニューラルネットワークを活用することで文章全体を1つのまとまりとして翻訳できるようになり、より自然な表現が可能になりました。

また、ニューラルネットワークを用いた翻訳技術により、文脈に沿った単語の選択ができるようになり、従来の手法と比較して翻訳エラーが削減されたと報告されています。さらに、ニュース記事やビジネス文書などの複雑な文章においても、より高精度な翻訳が行えるようになり、翻訳精度の向上が実現されています。ニューラルネットワークによる自然言語処理は、翻訳だけでなく、文章の要約、対話システム、感情分析などのさまざまな分野で活用されており、日常生活やビジネスの多くの場面でその技術が取り入れられています。

車の自動運転と画像認識

ニューラルネットワークは自動運転技術の中核を担う画像認識システムにも活用されています。自動運転車は周囲の環境を正確に把握し、適切な運転判断を行う必要があります。そのため、車載カメラやセンサーから取得した情報を解析し、障害物や歩行者の検出、信号や道路標識の認識、車線の維持などを行う高度な技術が求められます。

特に、ニューラルネットワークを活用した物体検出アルゴリズムにより、車両の進行方向に存在する歩行者や他の車両をリアルタイムで識別し、適切な回避行動を取ることが可能になりました。また、車両の軌道予測技術も発展しており、周囲の車両がどのような動きをするのかを予測しながら、安全な運転をサポートします。

さらに、従来の画像認識技術では処理が難しかった夜間や悪天候時の環境認識についても、ディープラーニングを活用することで認識精度が向上しつつあります。現在は一部の地域で自動運転の試験走行が行われており、将来的には一般道での完全自動運転の実現が期待されています。

参考:ニューラルネットワークと自動運転。多様なネットワークを組み合わせて多重化、冗長化で安全性を担保する――NVIDIA 室河徹氏

金融機関での株取引

金融業界でもニューラルネットワークはデータ解析の分野で重要な役割を果たしています。特に、株価の変動を予測するシステムでは、過去の市場データや経済指標、ニュース記事などをニューラルネットワークに学習させ、将来の株価の動向を予測することが可能になりました。

従来の統計モデルでは株価の変動パターンを明示的に定義する必要がありましたが、ニューラルネットワークを活用することで、膨大な市場データの中から自動的にパターンを抽出し、より精度の高い予測を行うことができます。さらに、機械学習モデルは市場のトレンドや異常な価格変動をリアルタイムで分析し、投資判断を支援するツールとしても利用されています。

また、不動産業界では物件の価格予測にもニューラルネットワークが導入されています。過去の取引データや地域の経済状況、周辺施設の情報などを考慮し、適正な価格を算出することで、不動産取引の効率化が進められています。

参考:ニューラル・ネットワークは金融取引に革命を起こすのか?

インターネット上でのコメント監視

インターネット上のコンテンツ管理においてもニューラルネットワークは活用されています。特に、大量のコメントが投稿されるソーシャルメディアやニュースサイトでは不適切な発言やスパム投稿の監視が求められます。

従来、このようなコメント監視は人手で行われていましたが、膨大な量の投稿をすべてチェックするのは困難でした。しかし、ニューラルネットワークを活用したテキスト解析技術により、不適切なコメントを自動で検出し、フィルタリングするシステムが導入されています。この技術は、単純なキーワード検出にとどまらず、文章の文脈を理解し、悪意のある表現や嫌がらせのコメントを高精度で判別することが可能になっています。

このシステムにより、企業やメディアはユーザー同士の健全なコミュニケーションを維持しやすくなり、オンライン上の誹謗中傷やフェイクニュースの拡散を防ぐための対策が強化されています。

参考:SHOWROOM、誹謗中傷コメントの監視AIを開発 “遠回しな言い方”でも検知して自動通報

医療における診断・判定

医療分野ではニューラルネットワークが診断支援のためのシステムとして活用されています。特に、内視鏡検査やCTスキャンの画像診断において、ディープラーニングを活用したAIシステムが導入され、疾患の早期発見が可能になりました。

例えば、胃がんの検出においては、ニューラルネットワークを用いることで、6mm以上の胃がんを約98%の精度で発見することが可能になったと報告されています。従来の診断では、医師が目視で判断を行うため、疾患の見落としが問題となっていましたが、AIを活用することでそのリスクが大幅に低減されています。

参考:【プレスリリース】人工知能で胃がんを発見する! -AIを活用した内視鏡画像診断支援システムの開発-

また、医療分野では新薬開発の分野にもニューラルネットワークが応用されています。新薬の開発には膨大なデータ分析が必要ですが、AIを活用することで、最適な化合物の組み合わせを予測し、開発期間の短縮やコスト削減につなげることが可能になっています。

参考:AIを活用した新薬創出

画像生成とクリエイティブ分野

ニューラルネットワークは画像生成や編集技術の進化を大きく後押ししています。様々なAIモデルにより、テキストから画像を自動生成する技術が一般ユーザーにも利用可能になりました。例えば、「雪の中を歩くロボット」や「ゴッホ風の夜景」といった指示に基づき、リアルな画像やアート作品を瞬時に作成できます。

また、超解像技術を活用し、低解像度の画像を鮮明に補正することも可能になったため、古い写真の修復や映像の品質向上が進んでいます。ゲームや映画の分野では、キャラクターや背景の自動生成が行われ、制作時間の短縮とコスト削減に貢献しています。

上記の技術の進化により、クリエイターだけでなく一般のユーザーも手軽にAIを活用し、創作の可能性が大きく広がっています。

参考:クリエイティブでもAIが力を発揮、進化する画像生成AIの今

音楽や動画のレコメンデーション

ニューラルネットワークは音楽や動画のレコメンデーションシステムにおいて重要な役割を果たしています。音楽配信サービスや動画ストリーミングプラットフォームでは、ユーザーの視聴履歴や嗜好を分析し、個々に最適なコンテンツを推薦するために、ディープラーニング技術が活用されています。

近年、従来の協調フィルタリングやコンテンツベースフィルタリングに加えて、行動シーケンスデータを活用するBST(Behavior Sequence Transformer)のような新しい手法が登場しました。BSTはユーザーの視聴傾向を時系列データとして捉え、直近の行動を重視しながら、長期的な嗜好変化にも適応することができます。BSTを活用することで新しいアーティストや映画を試しやすくなるなど、ユーザーの発見体験を向上させる効果があります。

NetflixやSpotifyのような大規模プラットフォームで既にBSTが採用されており、リアルタイムで最適なコンテンツを推薦することで視聴継続率の向上に貢献しています。

参考:BST(Behavior Sequence Transformer)とは何か?概要と特徴を徹底解説

最後に

ニューラルネットワークは、機械学習やディープラーニングの基盤技術として、多くの分野で活用されています。入力層、隠れ層、出力層の多層構造を持ち、データの特徴を学習することで、高精度な予測や分類が可能になります。この技術の進化により、従来の手法では困難だった複雑な問題にも対応できるようになりました。

特に、ディープラーニングの発展により、画像認識や自然言語処理の分野で大きな進歩が見られています。自動運転や医療診断、金融取引の分析など、実社会での応用も拡大しており、より精度の高いモデルの開発が求められています。また、音楽や動画のレコメンデーションシステムなど、日常生活においてもその活用が進んでいます。

ニューラルネットワークの技術が進化するにつれ、より高度なAIモデルの開発が期待されています。新たなアルゴリズムや学習手法の登場により、その可能性はさらに広がっていくと考えられます。AI技術の進展とともに、ニューラルネットワークがどのように発展していくのかが注目されています。