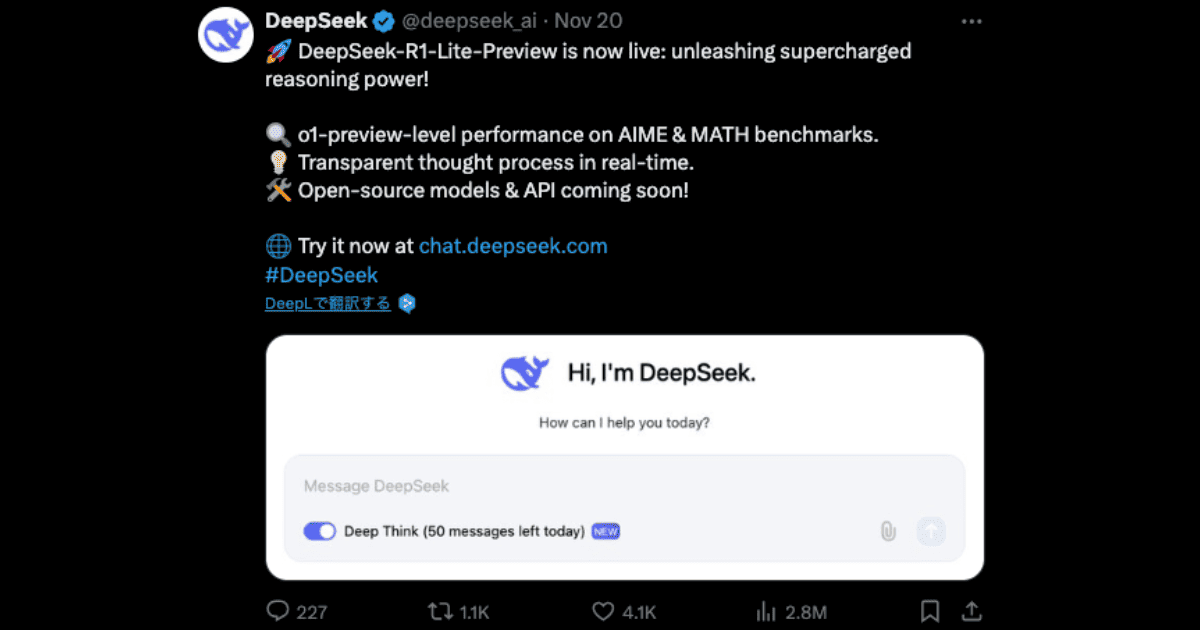

中国で言語モデルを開発するDeepSeekは新たに「DeepSeek-R1-Lite-Preview」を発表しました。DeepSeek-R1-Lite-Previewは高度な数学や論理的な問題に対応する高性能モデルで、一部のベンチマークで、高い推論性能で先行するOpenAIのo1-previewを上回る結果も示しています。DeepSeek-R1-Lite-Previewは近日オープンソースとして公開される予定とのことです。

DeepSeek-R1-Lite-Previewとは

DeepSeek-R1-Lite-Previewは、AIME(American Invitational Mathematics Examination)やMATHといった高難度な数学問題に対応して優れたパフォーマンスを示しています。他のモデルと比較して高い精度で問題解決が可能です。その上、ユーザーは、モデルの思考過程をリアルタイムで追跡可能で、どのようにして結論に至ったかを視覚化します。

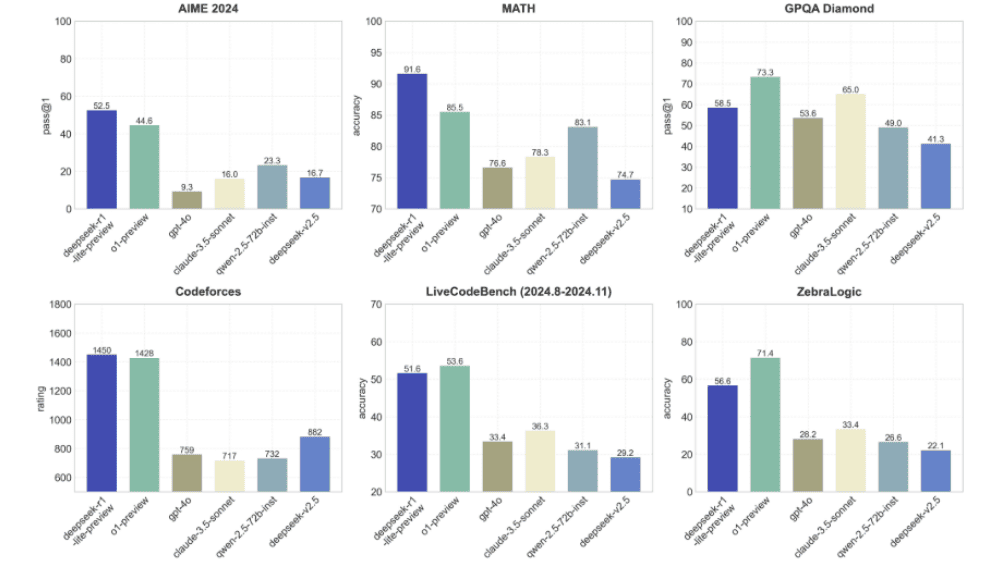

DeepSeek-R1-Lite-Previewは、AIME 2024やMATHなどのベンチマークで最高クラスの性能を示しており、他のモデルとの比較でも高い精度を達成しています。

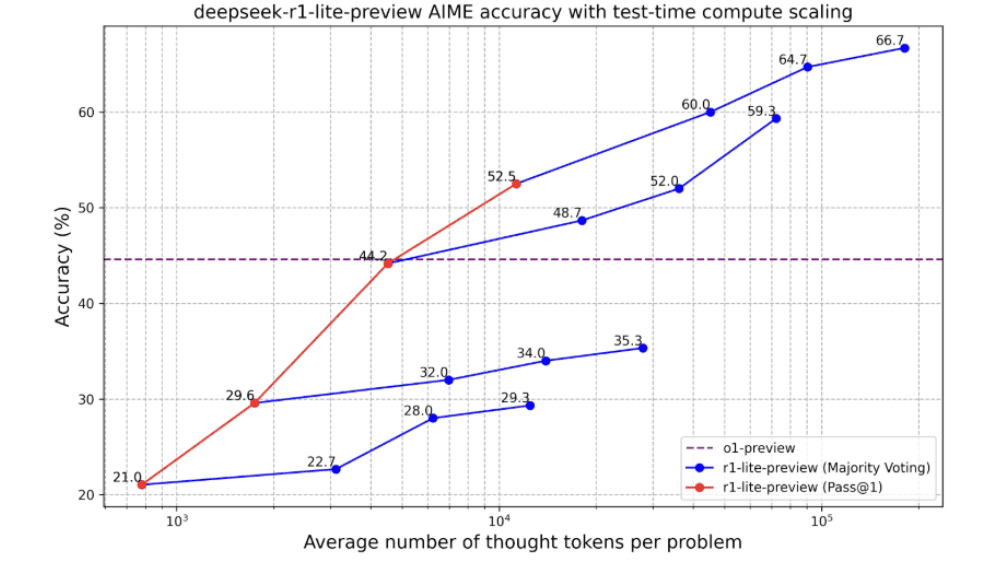

DeepSeek-R1-Lite-Previewの特徴の一つに、「思考トークンの長さ」に比例する推論性能の向上があります。AIMEベンチマークでは、モデルが処理するトークン数が増加するにつれて精度が向上する特性を示しています。

DeepSeek-R1-Lite-Previewはこちらからチャット件数の上限付きで公開されています。また近日中にオープンソースモデルとAPIが公開される予定です。

DeepSeekとは

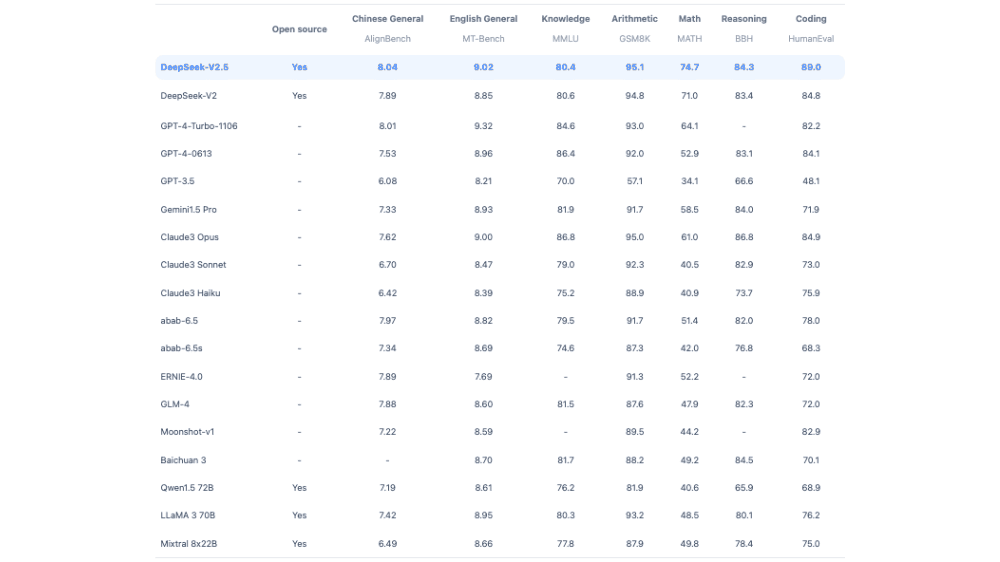

DeepSeekは中国のAI企業で、高性能な大規模言語モデルを開発している新しい企業です。設立からまだわずか1年ですが、DeepSeek-V2.5は数学やコーディング、論理タスクでGPT-4と同等かそれ以上の性能を示しています。

DeepSeekは、商用用途も含めた広い用途で利用可能なライセンスを提供しており、デモサイトも公開されており、誰でも試すことが可能です。

DeepSeekのAPIの利用料金は、100万トークンあたり入力0.14ドル、出力0.28ドルと非常に安価に設定されており、GPT-4や他社と比べても大きな強みです。GPT-4の場合、100万トークンあたり入力2.5ドル、出力10ドルとなっており、DeepSeekのコストパフォーマンスは強力です。

「DeepSeek-R1-Lite-Preview」について一言

LLMは対象とする言語よりパフォーマンスが異なります。現状はOpenAIのGPT-4oが多くの言語横断で高いパフォーマンスを示していますが、母国語に特化したLLM開発は依然として高く注目されています。

中国ではアリババ、バイドゥなどのテックジャイアントをはじめとしてスタートアップも含め多くの企業がLLM開発に取り組んでいますが、DeepSeek-R1-Lite-Previewの特徴としては推論性能でOpenAIのo1-previewと同水準の結果を示したことです。

LLM開発はこれまで学習量を増やす「スケーリング」といったアプローチが主でしたが、最近では推論時間を充実させるアプローチが目立ってきており、この分野でグローバルモデルに匹敵するパフォーマンスを示したことの、中国のLLM開発における意義は大きいと思います。

出所:DeepSeek(X)